NTTが「語彙の壁」を越える新技術を確立

近年、急速な進化を遂げている大規模言語モデル(LLM)は、文章の入出力単位である「トークン」を用いて推論を行います。しかし、LLMが異なると、そのトークン候補の集合である「トークン語彙」も異なるのが一般的でした。この語彙の不一致は「語彙の壁」として、複数のLLMを連携させる際の大きな障壁となっていました。

具体的には、複数のLLMの予測結果を統合して推論精度を向上させる「アンサンブル」や、専門知識を別のモデルに転移させるNTT独自の「ポータブルチューニング」といった技術は、トークン語彙が一致していることが前提とされていました。このため、開発組織や時期の異なる異種LLM間での密な連携は困難だったのです。

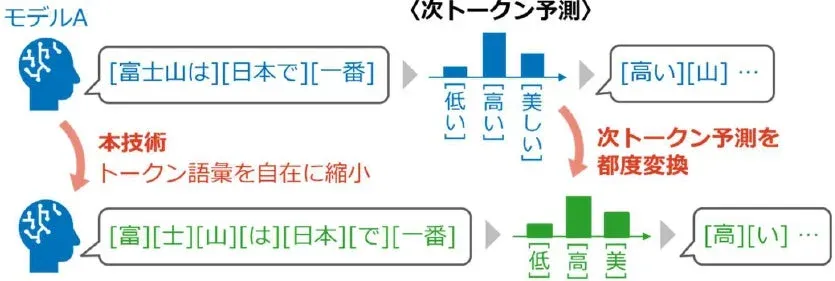

NTTは今回、この「語彙の壁」を克服する世界初の「トークン共通化」技術を確立したと発表しました。これにより、LLMの推論におけるトークン語彙を、精度を劣化させることなく自在に縮小できるようになり、異なるLLM間でも共通の語彙集合を介した連携が可能になります。

精度を維持したまま語彙を自在に縮小する画期的なアプローチ

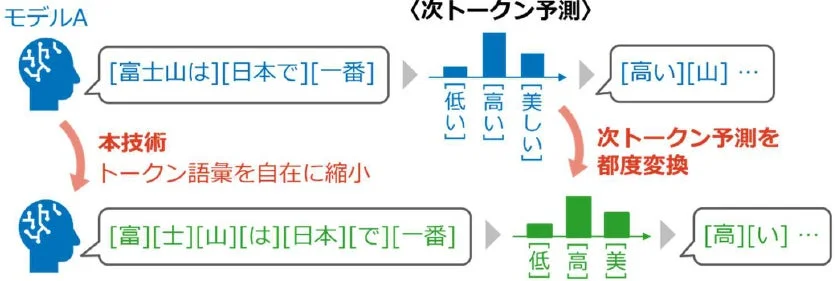

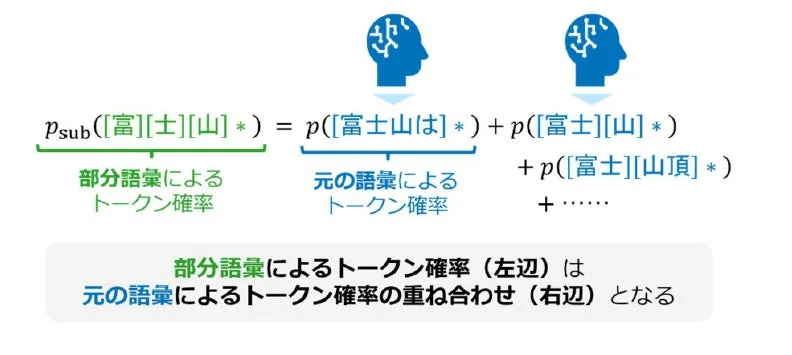

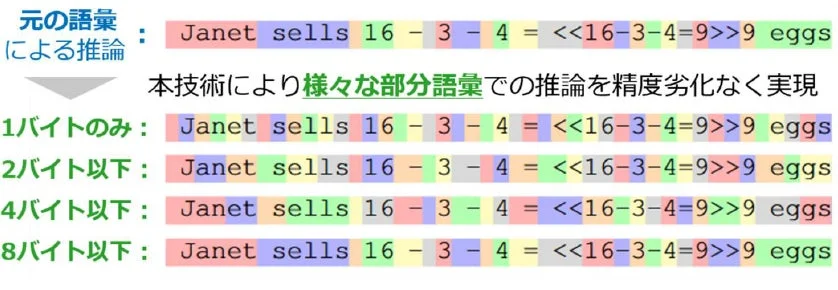

本研究の最大の成果は、LLMが推論に用いるトークン語彙を、精度を劣化させることなく自在に縮小できる技術を確立した点にあります。この技術は、LLMの推論中に計算される全てのトークンに対する次トークン予測結果を、指定された一部のトークン(部分語彙)のみを候補とする予測結果に変換するものです。

この変換において、最終的に出力される文章全体の傾向が変化しないよう、独自の理論に基づいた変換アルゴリズムが設計されました。これにより、元のLLMの推論精度を損なうことなく、任意の部分語彙での推論が可能になったのです。

「損失なし」で語彙を自在に縮小させる新理論

LLMの出力品質を維持しつつ、より少ないトークン候補(部分語彙)での次トークン予測を可能にする、世界初の理論が確立されました。この理論では、元の語彙に関するトークン確率と部分語彙に関するトークン確率を統一的に扱い、最終的な出力文字列の分布が不変となるための関係式を導出しています。この関係式に基づいて変換を行うことで、出力品質を変えずに部分語彙での推論が実現します。

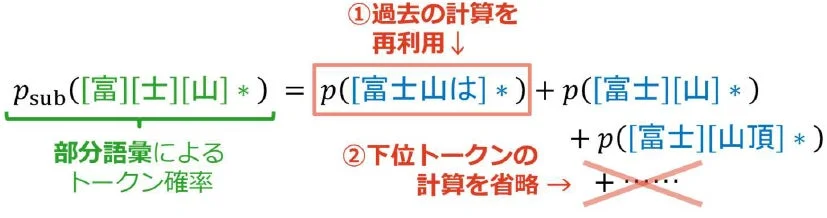

実用的な変換アルゴリズムを導出

理論の確立に続き、実用的な変換アルゴリズムも開発されました。このアルゴリズムは、計算上必要となる複数の次トークン予測の多くが過去の計算で再利用できる点や、確率値がほぼゼロとなる下位トークンは計算を省略できる点を考慮して設計されています。これにより、元の語彙による通常の推論時と同程度の計算コストで動作する効率的な変換が可能となりました。実際のLLMへの適用実験でも、理論通りの出力傾向を保ったまま、様々な部分語彙での推論が実現できることが確認されています。

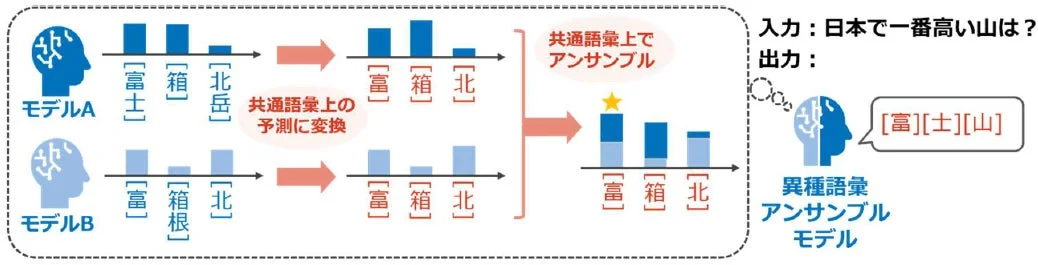

異種LLM間の知識統合・転移を可能にする「最大共通語彙」

上記の変換アルゴリズムを応用することで、異なる語彙を持つ複数の異種LLM間での次トークン予測の共有が可能になります。これは、それらのLLMに共通するトークン候補を全て集めた「最大共通語彙」で推論させることで実現されます。

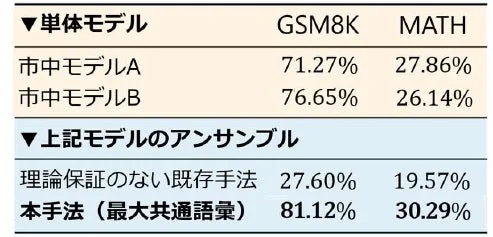

例えば、ある市中モデル同士の組み合わせでは、一方のLLMが約15万個、もう一方が約13万個のトークンを持つ場合でも、それらの最大共通語彙は約6万個のトークンからなる集合となります。このような共通語彙上で各LLMを推論させることで、推論精度や速度を犠牲にすることなく、アンサンブルによる知識統合やポータブルチューニングによる知識転移といった、次トークン予測の共有を必要とする様々な連携が異種LLM間で可能になります。

実際に語彙の異なるLLM同士に対して共通語彙によるアンサンブルを適用した実験では、出自の異なる知識の統合により、単体モデルに比べて推論能力が大幅に向上することが確認されています。

ICLR 2026での発表と今後の展望

本研究成果は、2026年4月23日から27日までブラジル・リオデジャネイロで開催される深層学習分野における最難関国際会議「International Conference on Learning Representations (ICLR) 2026」にて発表されます。

本技術の確立により、LLMの推論時の語彙を自在に縮小できるようになり、異なるトークン語彙を持つ異種LLM同士でも、次トークン予測レベルでの密な連携が可能となりました。今後、この技術をアンサンブルやNTT独自のポータブルチューニングなど、様々な連携技術と組み合わせることで、多様な異種LLM間での知識の統合や転移がさらに進むでしょう。特に、NTTが開発する大規模言語モデル「tsuzumi」など、独自の語彙を持つLLMでも、本技術の活用によって他の市中LLMとの連携が容易になっていくことが期待されます。

-

ICLR 2026での発表論文: Lossless Vocabulary Reduction for Auto-Regressive Language Models

-

ポータブルチューニング動画解説: 生成AIのカスタマイズコストを抜本的に削減するポータブルチューニング技術

-

NTT版大規模言語モデル「tsuzumi 2」: tsuzumi

-

ICLR 2026公式ウェブサイト: ICLR2026

AI Workstyle Lab編集部コメント

今回のNTTの「トークン共通化」技術は、異なるLLMを組み合わせることで、より専門的かつ高性能なAIシステムの構築を可能にします。例えば、特定の業界知識に特化したLLMと汎用LLMを連携させ、顧客対応の自動化や市場分析の精度向上に活用できるでしょう。これにより、企業は個別のLLMをゼロから開発するコストを削減しつつ、それぞれの強みを活かしたAIソリューションを迅速に導入できるようになります。AIの導入障壁が下がり、ビジネスにおける生産性向上と新たな価値創造に大きく貢献する可能性を秘めていると言えます。

「AIニュースは追っているけど、何から学べばいいか分からない…」 そんな初心者向けに、編集部が本当におすすめできる無料AIセミナーを厳選しました。

- 完全無料で参加できるAIセミナーだけを厳選

- ChatGPT・Geminiを基礎から体系的に学べる

- 比較しやすく、あなたに合う講座が一目で分かる

ChatGPTなどの生成AIを使いこなして、仕事・収入・時間の安定につながるスキルを身につけませんか?

AI Workstyle LabのAIニュースをチェックしているあなたは、すでに一歩リードしている側です。あとは、 実務で使える生成AIスキルを身につければ、「知っている」から「成果を出せる」状態へ一気に飛べます。

講師:栗須俊勝(AI総研)

30社以上にAI研修・業務効率化支援を提供。“大阪の生成AIハカセ”として企業DXを牽引しています。

- 日々の業務を30〜70%時短する、実務直結の生成AI活用法を体系的に学べる

- 副業・本業どちらにも活かせる、AI時代の「稼ぐためのスキルセット」を習得

- 文章・画像・資料作成など、仕事も趣味もラクになる汎用的なAIスキルが身につく

ニュースを読むだけで終わらせず、

「明日から成果が変わるAIスキル」を一緒に身につけましょう。

本記事は、各社の公式発表および公開情報を基に、AI Workstyle Lab編集部が 事実確認・再構成を行い作成しています。一次情報の内容は編集部にて確認し、 CoWriter(AI自動生成システム)で速報性を高めつつ、最終的な編集プロセスを経て公開しています。