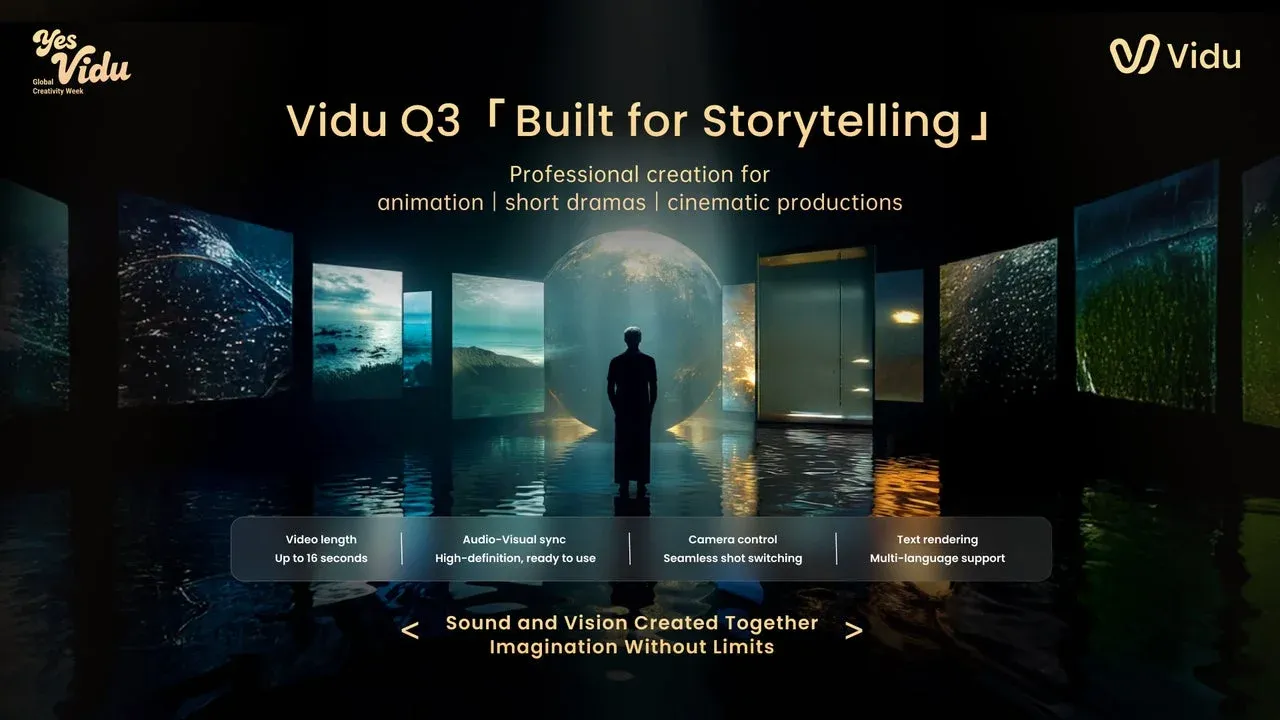

Vidu Q3:ストーリーテリングのための音声・映像統合生成

今回発表された主要モデルの一つが、最大16秒のネイティブ音声・映像を単一パスで生成する長編AI動画モデル「Vidu Q3」です。Q3はナラティブ(物語)制作向けに設計されており、音声と映像をモデルレベルで直接統合することで、完全に同期されたストーリーテリングを実現します。

Vidu Q3の主な機能は以下の通りです。

-

音声・映像の同時生成: 最大16秒のネイティブ音声・映像を単一パスで出力します。

-

多言語対応リップシンク: 中国語・日本語・英語に対応し、キャラクターの口の動きが発話内容と完全に同期します。

-

映画的カメラ制御: ドリー、パン、チルトの詳細指定や、シームレスなカット割り制御が可能です。

-

ネイティブ1080p(フルHD)出力: 看板・字幕・UI要素などのテキスト情報も正確に表現します。

-

ストーリーボード編集: 時間経過とテンポ調整が単一カット内で可能です。

活用シーンとしては、TikTokやYouTube Shortsといったショート動画プラットフォームへの即時投稿、多言語マーケティング動画の効率的な制作、アニメーションや映像制作におけるセリフ生成とリップシンクの自動化などが挙げられます。

Vidu Q3の詳細はこちらをご覧ください。

Vidu Q3について

Vidu Q2 Reference-to-Video Pro:制御可能なクリエイションの実現

同時に「あらゆるものを参照素材として活用できる」世界初の動画モデル「Vidu Q2 Reference-to-Video Pro」も発表されました。このモデルは、AI動画生成を一発生成から構造化された参照駆動型のワークフローへ拡張し、より高い制御性、一貫性、制作効率を実現します。統合ワークフロー内で2つの動画参照と4つの画像参照を同時にサポートします。

主な機能は以下の通りです。

-

複数参照の同時活用: 2つの動画と4つの画像を統合ワークフロー内で参照可能です。

-

要素の追加・削除・変更: 全体を再生成することなく部分修正が可能です。

-

表情・感情転写: 参照動画の表情や感情の流れを別の人物へ転写できます。

-

動作再現: ダンスなどの動作を異なるキャラクターで再現します。

-

スタイル変換: 動画全体を日本アニメ風、ピクサー風、クレイアニメーション風などに一括変換できます。

Vidu Q2 Reference-to-Video Proの詳細はこちらをご覧ください。

Vidu Q2 Reference-to-Video Proについて

その他の主要アップデート

Reference Hub:世界初のAI動画主体ベース制作コミュニティ

Reference Hubは、Viduの参照駆動型動画生成フレームワークをベースに構築されたAI動画主体ベース制作コミュニティです。クリエイターは8つの構造化された主体カテゴリから選択することで、高い一貫性と効率でプロフェッショナルグレードの動画を制作できます。ローンチ時点で、カメラワーク、構図、ナラティブ構造、視覚スタイル、シーンデザイン、キャラクターパフォーマンス、アビリティ、ムードにわたる200種以上の厳選された主体が利用可能です。

Reference Hubの詳細はこちらをご覧ください。

Reference Hubについて

Vidu Agent 1.0:ワンクリック動画制作を実現

Vidu Agent 1.0は、インテリジェントなプランニングとリアルタイム生成により、ワンクリック動画制作を可能にします。

新機能は以下の通りです。

-

カスタムBGMアップロード:ユーザー独自のBGMファイルをアップロードして動画に自動同期します。

-

ナレーション削除機能:AI生成ナレーション音声の有無を選択可能です。

-

ストーリーボードベース編集:シーン構成から映像生成、音声追加、BGM挿入までを自動実行します。

Vidu Agent 1.0の詳細はこちらをご覧ください。

Vidu Agent 1.0について

研究開発と市場における競争力

Viduは、最先端研究を実用可能なシステムへ迅速に転換し、制作ワークフローへ直接組み込む「研究開発の実装速度」を競争力の源泉としています。清華大学との共同研究によるTurboDiffusion(推論速度最大200倍高速化)がその核心技術であり、OpenAI Soraをはじめとするグローバル競合との差別化要因となっています。

AI評測権威機関「Artificial Analysis」が発表した最新のText-to-Videoリーダーボードでは、Vidu Q3 ProがELOスコア1,241を獲得し、グローバル第2位にランクインしました。これはRunway Gen-4.5(3位)、Google Veo 3.1(5位)、OpenAI Sora 2 Pro(10位)といった主要競合を上回る結果です。

Artificial Analysisのリーダーボードはこちらをご覧ください。

Text-to-Video Leaderboard

グローバル展開と市場の背景

2024年4月のローンチ以降、Viduは200以上の国と地域で展開され、4,000万人以上のクリエイターと10,000以上の開発者・企業顧客にサービスを提供しています。プラットフォーム上で生成された動画は5億本以上に達し、総出力の70%以上が商業プロジェクトとして活用されているとのことです。

日本国内の動画配信サービス市場は2024年度で約6,500億円規模に達し、グローバルではAI動画生成市場が2025年に約7.168億米ドル、2032年には25.629億米ドル(年平均成長率20.0%)へ拡大する見込みです。ショート動画の視聴回数も急増しており、このような需要拡大の背景で、動画制作の時間とコスト、そして高度な技術を要する課題解決が求められています。

提供開始日および料金プラン

新機能は2026年1月30日より順次展開されます。

料金プランには無料プラン(80クレジット相当の機能試用)と、有料プラン(スタンダード、プレミアム、アルティメット、エンタープライズ)が用意されています。

詳細な料金およびクレジット体系については、公式サイトをご確認ください。

Vidu 料金プラン

参考:用語ミニ辞典

-

リップシンク(Lip Sync): 音声とキャラクターの口の動きを同期させる技術です。

-

マルチモーダルAI: テキスト・画像・音声・動画など、複数の情報形式を統合的に扱うAI技術です。

-

1080P(フルHD): 1920×1080ピクセルの解像度で、多くの配信プラットフォームで標準的な高画質フォーマットです。

-

U-ViTアーキテクチャ: 拡散モデルとトランスフォーマーフレームワークを統合した、ShengShu Technology独自開発の基盤技術です。

-

TurboDiffusion: 清華大学TSAIL研究室と共同開発した高速化フレームワークで、生成品質を維持したまま推論速度を最大200倍に高速化します。

サービス概要

-

サービス名称: Vidu(ヴィドゥ)

-

公式URL: https://www.vidu.com

-

X – Vidu Official: https://x.com/ViduAI_official

-

X – Vidu Japan: https://x.com/Vidu_JP

ShengShu AI(生数AI)について

ShengShu AIは、2023年3月6日に中国・北京で設立されたAIスタートアップ企業です。清華大学人工知能研究院出身者を中心に構成され、マルチモーダル大規模基盤モデルの研究開発とその応用サービス提供を事業としています。主力製品である「Vidu」は、長編コンテンツにも対応できる高い一貫性とダイナミクスを備えたAI動画生成プラットフォームです。

ShengShu AI HK Limitedは、グローバル向けAI動画生成サービス「Vidu」の開発・運営を担い、特に日本や他アジア市場へのローカライズ・サポートを提供しています。

AI Workstyle Lab編集部コメント

Viduの大規模アップデートは、動画コンテンツ制作に携わる企業や個人事業主にとって、大きなビジネスチャンスをもたらすでしょう。特に「Vidu Q3」による音声・映像の統合生成は、これまで手作業で行っていたリップシンクやカメラ制御などの複雑な工程をAIが自動化し、制作にかかる時間とコストを劇的に削減します。これにより、マーケティング動画や教育コンテンツ、短編ドラマなどの多言語展開が容易になり、グローバル市場への迅速なアプローチが可能になります。AI Workstyle Lab編集部としては、クリエイターがより創造的な作業に集中できる環境が整い、新たなビジネスモデルや収益源の創出につながる可能性を秘めていると見ています。

「AIニュースは追っているけど、何から学べばいいか分からない…」 そんな初心者向けに、編集部が本当におすすめできる無料AIセミナーを厳選しました。

- 完全無料で参加できるAIセミナーだけを厳選

- ChatGPT・Geminiを基礎から体系的に学べる

- 比較しやすく、あなたに合う講座が一目で分かる

ChatGPTなどの生成AIを使いこなして、仕事・収入・時間の安定につながるスキルを身につけませんか?

AI Workstyle LabのAIニュースをチェックしているあなたは、すでに一歩リードしている側です。あとは、 実務で使える生成AIスキルを身につければ、「知っている」から「成果を出せる」状態へ一気に飛べます。

講師:栗須俊勝(AI総研)

30社以上にAI研修・業務効率化支援を提供。“大阪の生成AIハカセ”として企業DXを牽引しています。

- 日々の業務を30〜70%時短する、実務直結の生成AI活用法を体系的に学べる

- 副業・本業どちらにも活かせる、AI時代の「稼ぐためのスキルセット」を習得

- 文章・画像・資料作成など、仕事も趣味もラクになる汎用的なAIスキルが身につく

ニュースを読むだけで終わらせず、

「明日から成果が変わるAIスキル」を一緒に身につけましょう。

本記事は、各社の公式発表および公開情報を基に、AI Workstyle Lab編集部が 事実確認・再構成を行い作成しています。一次情報の内容は編集部にて確認し、 CoWriter(AI自動生成システム)で速報性を高めつつ、最終的な編集プロセスを経て公開しています。